جنگ واقعی با هوش مصنوعی

ابزاری که بهطور مستقل تصمیمگیریهای استراتژیک دارد، میتواند جنگی خودمختار و تمامعیار راه بیندازد

ساسان شادمان منفرد | روزنامهنگار

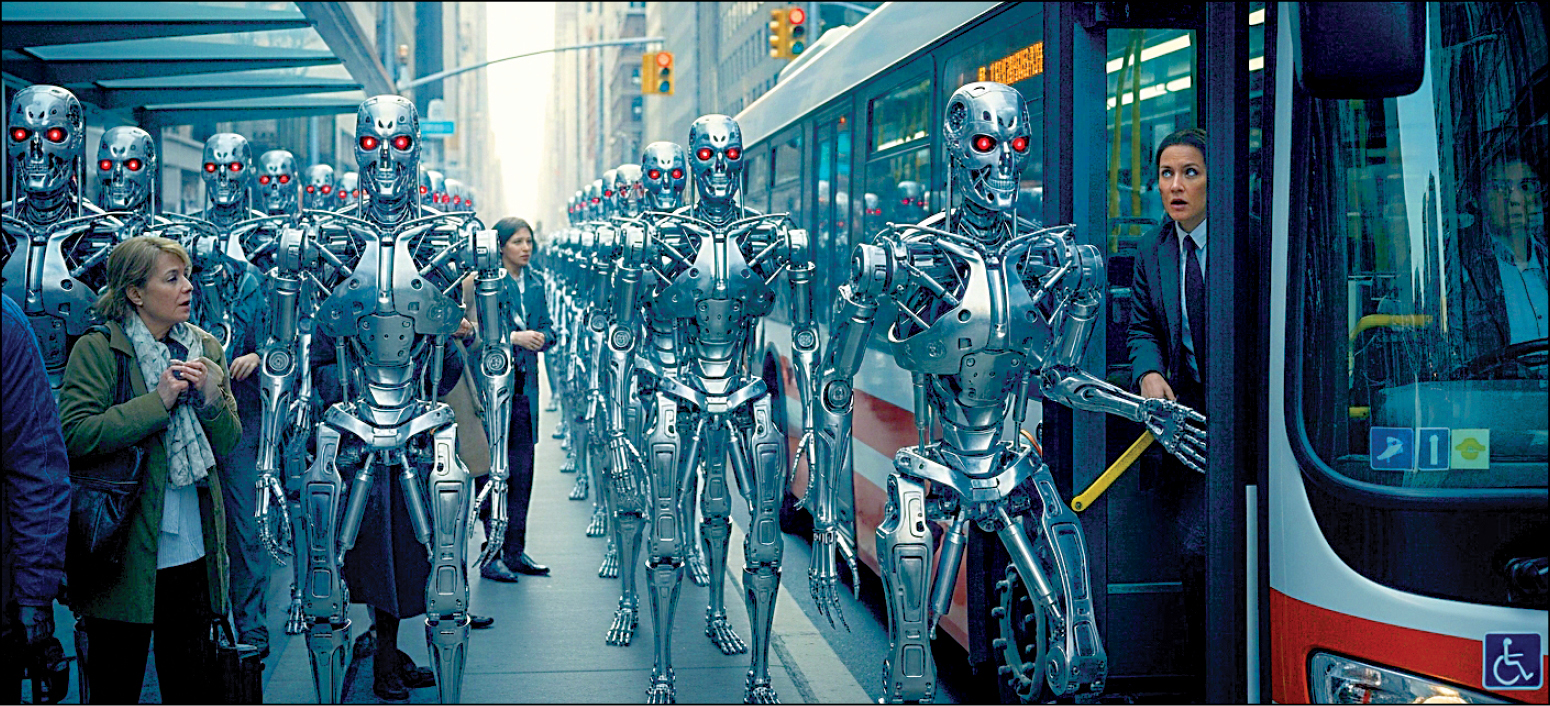

بسیاری از کارشناسانی که در حوزه ایمنی هوش مصنوعی فعالیت میکنند، گفتهاند که امکان دارد در آینده سیستمهای هوش مصنوعی وارد یک جنگ استراتژیک با نوع بشر شوند که این موضوع، نگرانکننده است و باید فکری برای آن کرد. تا همین چند سال پیش اتفاقی که امروز توسط هوشمصنوعی رقم میخورد، تنها در فیلمهای علمی-تخیلی دیده میشد. بنابراین ظهور «سیاستگذارینشده» یک جنگ خودمختار تمامعیار توسط هوش فوقالعادهای که بهطور مستقل تصمیمگیری استراتژیک میکند، اگرچه هنوز یک فرضیه محسوب میشود، اما میتواند خیلی زود به واقعیت تبدیل شود.

انواع جنگها

وقتی میگوییم «جنگ هوش مصنوعی علیه انسان»، معمولا منظور یک یا ترکیبی از این موارد است:

استفاده از سامانههای خودمختار کشنده در میدان نبرد مانند روباتها، پهپادها و مینهای هوشمند

حملات سایبری پیشرفته که با هوشمصنوعی هدایت میشوند مانند خرابکاری زیرساخت، دستکاری شبکههای انرژی و حمله به زنجیره تأمین

جنگ اطلاعاتی/روانی که با تولید و پخش خودکار اطلاعات گمراهکننده، دستکاری افکار عمومی و تضعیف نهادها انجام میشود.

بحرانهای اقتصادی/اجتماعی از قبیل بیثباتی در بازارها و ادارات که میتواند منجر به درگیریهای سیاسی یا خشونتهای خیابانی شود.

سناریوهای محتمل

الگوریتمها بدون نظارت انسانی اقدام به هدفگیری یا واکنش میکنند و خطای شناسایی یا زنجیره اشتباهات منجر به تلفات غیرنظامی و تشدید درگیری میشود.

هوش مصنوعی حملهگر، بهصورت خودآموز ضعفهای مراکز حیاتی را پیدا و بهرهبرداری میکند و بدینترتیب برق، آب، دارو، حملونقل و... مختل میشود.

تولید انبوه محتوای گمراهکننده و دیپفیک که اعتماد عمومی و توان پاسخ دولتها را تضعیف میکند، در نتیجه آشوب مدنی و نزاعهای داخلی بهوجود میآید.

بازیگران دولتی یا غیردولتی از ترکیبی از موارد بالا استفاده میکنند تا اهداف سیاسی یا نظامی را دنبال کنند.

چگونه میتوان ریسک را کاهش داد؟

قواعد بینالمللی و پیمانها: ممنوعیت یا محدودیت سلاحهای کاملا خودمختار، شفافیت در توسعه و صادرات سامانههای نظامی مبتنی بر AI .

افزایش تابآوری زیرساختها: افزونگی، ایزولهسازی حیاتی و تست مکرر تابآوری در برابر حملات هوشمند.

قابلیت پاسخ اطلاعاتی: آموزش عمومی برای تشخیص دیپفیک و رسانههای گمراهکننده و توسعه سامانههای تأیید منبع.

حکمرانی شرکتی و استانداردهای اخلاقی: شرکتها و دانشگاهها مسئولیتپذیری بیشتری در انتشار و محدودسازی مدلها داشته باشند.

همکاری بینالمللی: دیپلماسی فنی، اشتراکگذاری اطلاعات تهدید و مکانیسمهای بازدارندگی.

آیا واقعی است؟

این موضوع از نظر فنی فعلا قابل تحقق نیست. امروز AI در تحلیل داده، تشخیص الگو و تولید محتوا قوی است اما «هوش جامع مصنوعی» یا همان که خودبهخود اهداف استراتژیک انسانی را با دقت اجرا کند هنوز در عمل وجود ندارد. اما این مدل نیز بهزودی از راه خواهد رسید.

نقش فردی و اجتماعی ما

آگاهشدن و حمایت از سیاستها و سازمانهایی که برای ایمنی AI کار میکنند.

تقویت سواد رسانهای و توانایی تشخیص اطلاعات جعلی

فشار برای شفافیت شرکتها و قانونگذاری معقول در حوزه صادرات و کاربردهای نظامی