هوش مصنوعی؛ دوست یا دشمن؟

تهدیدهای هوش مصنوعی با سیاستگذاریهای درازمدت و انعطافپذیر و همچنین درنظرگرفتن اخلاقیات میتواند جهان را به نفع نوع بشر تغییر دهد

عماد الدین قاسمی پناه-روزنامهنگار

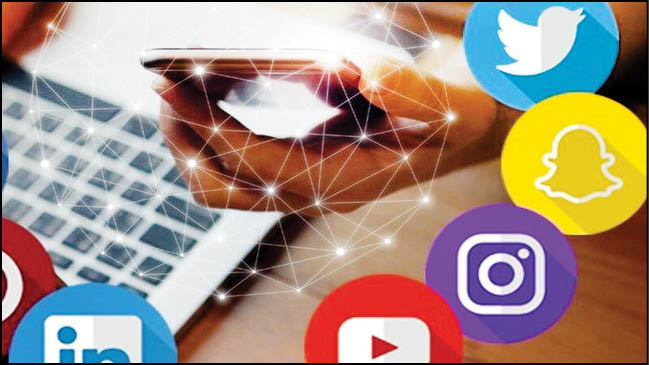

آیا هوش مصنوعی ترسناک است؟ آیا این فناوری قرار است در برابر نوع بشر باشد یا در کنار آن؟ این سؤالها مدتهاست که ذهن بسیاری را بهخود مشغول کرده، چراکه پاسخ به آن ساده و «بله» یا «نه» نیست. سینما یکی از مدیومهایی است که هوش مصنوعی را ترسناک نشان داده است. فیلمهایی که طی دهههای گذشته ساخته شده، غولهایی را به نمایش گذاشته که شهرها و تاسیسات را تخریب کرده و جان انسانها را گرفته اند. همچنین اخیرا مقالههای متعددی درباره ازدسترفتن بخشی از مشاغل و کسبوکارها در رسانهها با توسعه هوش مصنوعی منتشر شده است. حتی گاهی به مواردی چون بهخطرافتادن حریم خصوصی افراد و اثرات زیستمحیطی این فناوری اشاره شده است. این در حالی است که عدهای هوش مصنوعی را برای انسان مفید دانسته و استفاده از آن در زندگی انسان را راهگشا میدانند. آنها بر کاربردهای مختلف هوش مصنوعی در حوزههای گوناگون تأکید میکنند و معتقدند که این فناوری میتواند جهان را به نفع انسان تغییر دهد. با این اوصاف، یک نکته قابل اجماع است: هوش مصنوعی مانند هر فناوری دیگر میتواند هم مضر باشد و هم مفید. بهعبارت دیگر، اگر سیاستگذاران نحوه مواجهه با این فناوری و مدیریت توسعه آن را براساس یک استراتژی همهجانبهنگر تنظیم کنند، قطعا مزایای آن بر مضارش میچربد.

نگرانی جهانی

به زبان ساده، هر شغلی که یکنواختتر، تکراریتر، قابل برنامهریزیتر و معمولیتر باشد، بیشتر در معرض خطر ازدسترفتن خواهد بود. پاسخگویی به تلفن مشتریان، راهنمایی مسافران در فرودگاهها، ایستگاههای قطار، بنادر و هتلها، جداکردن اشیا در سطل زباله، شستن ظروف، چیدن میوهها، بلیتفروشی، نظافت بیمارستان و هتل، چیدمان انبارها، تحویل کالا و حتی رانندگی بخشی از این مشاغل است.

اکنون برخی از مدلهای زبانی هوش مصنوعی تهدیدهای جدیدی برای بعضی از مشاغل دیگر ایجاد کردهاند. روزنامهنگاری، برنامهنویسی کامپیوتر، دستیاری پزشکی، رادیولوژی و حقوقی در شمار اینگونه مشاغل است. با این حال، افرادی که در مشاغل نیازمند تحلیل و موقعیتشناسی سریع اشتغال دارند، نباید نگران ازدستدادن شغل خود باشند. بهعنوان مثال، روزنامهنگاری تحقیقی، شغلی نیست که هوش مصنوعی بهراحتی بتواند از پس آن بربیاید. ضمن اینکه همزمان با توسعه هوش مصنوعی، مشاغل جدید هم ایجاد میشود.

هوش مصنوعی و محیطزیست

بسیاری از سرمایهگذاران حوزههای مختلف ازجمله صنعت هوش مصنوعی را مفید تلقی میکنند. هدف آنها کاهش هزینهها و افزایش بهرهوری برای تولید کالا و ارائه خدمات است. بهعنوان مثال، آمازون تلاش میکند که برای چیدن، بستهبندی و ارسال کالاها از روباتهای مبتنی بر هوش مصنوعی استفاده کند. همچنین خودروسازان بزرگ دنیا از هوش مصنوعی برای تولید خودرو بسیار استفاده میکنند. با این حال، بخش عمدهای از دانشمندان معتقدند که هوش مصنوعی میتواند به انتشار کربن و آلودگی محیطزیست دامن بزند. دانشگاه ماساچوست در یکی از پژوهشهای خود برآورد کرده است که میزان کربن تولید شده بابت آموزش یک مدل ترنسفورمر مانند BERT یا GPT 2 که براساس جستوجوی معماری عصبی عمل میکند، با ردپای کربنی یک خودرو به علاوه سوخت آن برابری میکند. این در حالی است که اگر بعضی موارد در مورد توسعه هوش مصنوعی رعایت شود، احتمالا در درازمدت انتشار کربن در سراسر دنیا کاهش خواهد یافت.

خطر دستکاری هوش مصنوعی

در بهمنماه1401 تعدادی از دانشمندان هشدار دادهاند که هوش مصنوعی ظرفیت سوءاستفاده برای طراحی سلاحهای بیولوژیکی و شیمیایی بسیار سمی را دارد.

4محقق که برای کشف داروی مبتنی بر هوش مصنوعی تلاش میکنند، هشدار دادهاند که فناوری هوش مصنوعی را میتوان بهراحتی دستکاری کرد تا به عوامل عصبی سمی دست پیدا کند که از آن میتوان برای جنگهای بیولوژیکی یا شیمیایی استفاده کرد.

این پژوهشگران از سوی مؤسسه فدرال سوئیس برای حفاظت هستهای، بیولوژیکی و شیمیایی مأمور شدند تا ببینند آیا میتوان هوش مصنوعی را به سمت انگیزههای شوم دستکاری کرد یا نه. آنها نه یک یا 2مورد، بلکه 40هزار داروی بالقوه سمی را تنها در 6ساعت تولید کردند.

فابیو اوربینا، یکی از محققان و نویسنده اصلی مقالهای که جزئیات این یافتهها را شرح میدهد، میگوید: نگرانی اصلی این نیست که هوش مصنوعی این مولکولها را که بسیاری از آنها شبیه عوامل جنگ شیمیایی هستند، ساخته است؛ نگرانی اصلی این است که این اتفاق چقدر راحت رخ میدهد.

علت نگرانی از هوش مصنوعی

در پژوهشی که با حضور 929شرکتکننده انجام شد، آنها عواقب ناگواری را با ظهور هوش مصنوعی پیشبینی کردند. آنها بر این گمان بودند که این فناوری تأثیر منفی و مستقیمی بر روابط بینفردی، میزان اشتغال و فرصتهای شغلی خواهد داشت و در نتیجه منجر به بحرانهای اقتصادی میشود. خطر افزایش درگیریهای نظامی، تولید سلاحهای مخربتر و درنهایت نابودی نوع بشر از نگرانیهای دیگر این گروه بود.

در مطالعه دیگری که توسط دانشمندان دانشگاه فناوری کمنیتس آلمان انجام شد، شرکتکنندگان به 2مکالمه احساسی مشابه گوش دادند؛ یکی بین 2انسان و دیگری بین 2آواتار دیجیتال. به بعضی از افراد گفته شد که مکالمه به وسیله انسانها انجام میشود، درحالیکه به گروه دیگر گفته شد، مکالمه توسط هوش مصنوعی ساخته شده است. اما واقعیت این بود که همه مکالمهها از قبل به وسیله انسان نوشته شده بودند. داوطلبانی که به آنها گفته شد مکالمه به وسیله ماشین تولید شده است، به شکل قابلتوجهی احساس خوبی از آن نداشتند.

دانشمندان این بیاعتمادی و ناراحتی را به احساس اولیه ما از نیاز به کنترل نسبت میدهند. با هوش مصنوعی، ما این حس کنترل را از دست میدهیم و در نتیجه باعث ایجاد ترس و اضطراب میشویم. ماشینهایی که میتوانند مانند انسان فکر کنند، عمل کنند و واکنش نشان دهند، بهعنوان یک تهدید تلقی میشوند.

مدیریت توسعه

درحالیکه همیشه این امکان وجود دارد که رویدادها یا تحولات پیشبینینشده منجر به نابودی انسان به وسیله هوش مصنوعی شود، بعید است در آینده نزدیک شاهد چنین اتفاقی باشیم. در عوض، بهاحتمال زیاد هوش مصنوعی به تکامل و بهبود خود ادامه خواهد داد و مزایای قابلتوجهی برای جامعه فراهم میکند و در عین حال خطرات عمدهای را نیز به همراه دارد که باید به دقت مدیریت شوند.

در نتیجه، درحالیکه پتانسیل هوش مصنوعی برای تخریب، یک نگرانی واقعی به شمار میآید، مهم است که به یاد داشته باشیم که هوشمصنوعی ذاتا شیطانی نیست. بلکه ابزاری است که میتواند هم برای مقاصد خیر و هم برای اهداف شرورانه از آن استفاده شود.

با تنظیمگری توسعه هوش مصنوعی و محدودکردن یلگی آن، میتوانیم اطمینان حاصل کنیم که از آن برای بهبود وضعیت بشر استفاده میشود، نه برای نابودی آن. در نهایت، کلید بهکارگیری قدرت هوش مصـنـوعی در تــوسعه مســئــولانه و اجرای اخلاقی آن نهـفته است.

مکث

مکث

پشیمانی پدرخوانده از خلق هوشمصنوعی

در کنار نگاه مثبت به هوشمصنوعی، دانشمندان ردهبالایی هم هستند که دلخوشی از پیشرفت افسارگسیخته این فناوری ندارند.

شاید مهمترین مورد همین چند روز پیش بود که «جفری هینتون» که به پدرخوانده هوش مصنوعی معروف است، در مصاحبه جدیدی گفت: در بخشی از وجود خود بهخاطر کارهایی که انجام داده است، احساس پشیمانی میکند.

به گزارش نیویورکتایمز، جفری هینتون، دانشمندی که به همراه 2نفر از شاگردان خود قلب تپنده سیستمهای هوش مصنوعی امروزی را خلق کرده است، پس از یک دهه فعالیت در گوگل به همکاری خود در این شرکت پایان داد. او که پیشتر از نقد هوش مصنوعی خودداری کرده بود، میگوید حالا میتواند آزادانه درمورد خطرات این تکنولوژی صحبت کند. وی بیان می کند بخشی از وجودش از ماحصل یک عمر کارش پشیمان است. جفری هینتون، درباره تلاشهای گذشته خود میگوید: «بهخودم با این بهانه رایج دلداری میدهم که اگر من این کار را نمیکردم، شخص دیگری آن را انجام میداد. بهسختی میتوان فهمید که چگونه میشود جلوی افراد خرابکار را گرفت تا از این فناوری برای کارهای مخرب استفاده نکنند.»

هینتون و دانشجویانش چندین سال قبل یک شبکه عصبی ساختند که بهخودش یاد میداد چگونه پس از تحلیل هزاران تصویر باید اشیایی مثل سگها، گربهها و گلها را شناسایی کند. همین شبکه درنهایت منجر به ساخت ابزارهایی مثل ChatGPT و بارد گوگل شد.

پدرخوانده هوش مصنوعی میگوید تا زمانی که مایکروسافت بینگ جدید را با هوش مصنوعی معرفی کرد، از شیوه برخورد گوگل با این فناوری راضی بوده، اما با این اقدام گوگل هم وارد وضعیت قرمز شد تا پاسخی به رقیب خود بدهد. هینتون میگوید: چنین رقابت شدیدی در بین غولهای فناوری میتواند توقفناپذیر باشد و جهانی را بهوجود بیاورد که پر از تصاویر و نوشتههای جعلی خواهد بود و هیچکس، دیگر نمیتواند واقعیت را تشخیص دهد.

با اینکه سوندار پیچای، مدیرعامل گوگل هم درمورد هوش مصنوعی هشدار داده است و از جامعه خواسته خود را برای این تکنولوژی آماده کند، اما پیش از ترک گوگل نام هینتون در هیچکدام از هشدارهای جدی درمورد این تکنولوژی دیده نمیشد.

هینتون نگران است که هوش مصنوعی بازار کار را متحول کرده و جایگزین بسیاری از مشاغل شود. ابزارهای هوشمندی مثل ChatGPT فعلا بهعنوان یک ابزار کمکی به بهبود روند کار کمک میکنند، اما در آینده ممکن است جایگزین یکسری از مشاغل شوند. او نگران است که نسخههای بعدی این تکنولوژی حتی به تهدیدی برای بشریت تبدیل شوند؛ زیرا این تکنولوژی معمولا رفتار غیرمنتظرهای را از دادههای آموزشی خود یاد میگیرد. بهگفته هینتون، این مسئله در آینده مشکلساز میشود. در آینده علاوه بر اینکه افراد و شرکتها به این سیستمها اجازه میدهند تا کد کامپیوتری تولید کنند، بحث اجرا هم احتمالا به همین ابزار واگذار میشود.

هینتون هراسان است که در آینده سلاحهای تمام خودکار-مثلا روباتهای قاتل- به واقعیت بدل شوند.